Entropia é uma noção que deriva de um vocábulo grego que se pode traduzir por “volta” (regresso) ou “transformação” (em sentido figurado). Trata-se de um conceito que se utiliza na física, na química, na informática, na matemática e na linguística, entre outros âmbitos.

A entropia pode ser a magnitude (grandeza) física termodinâmica que permite medir a parte não utilizável da energia contida num sistema, o que significa que essa parte da energia não pode ser usada para produzir um trabalho.

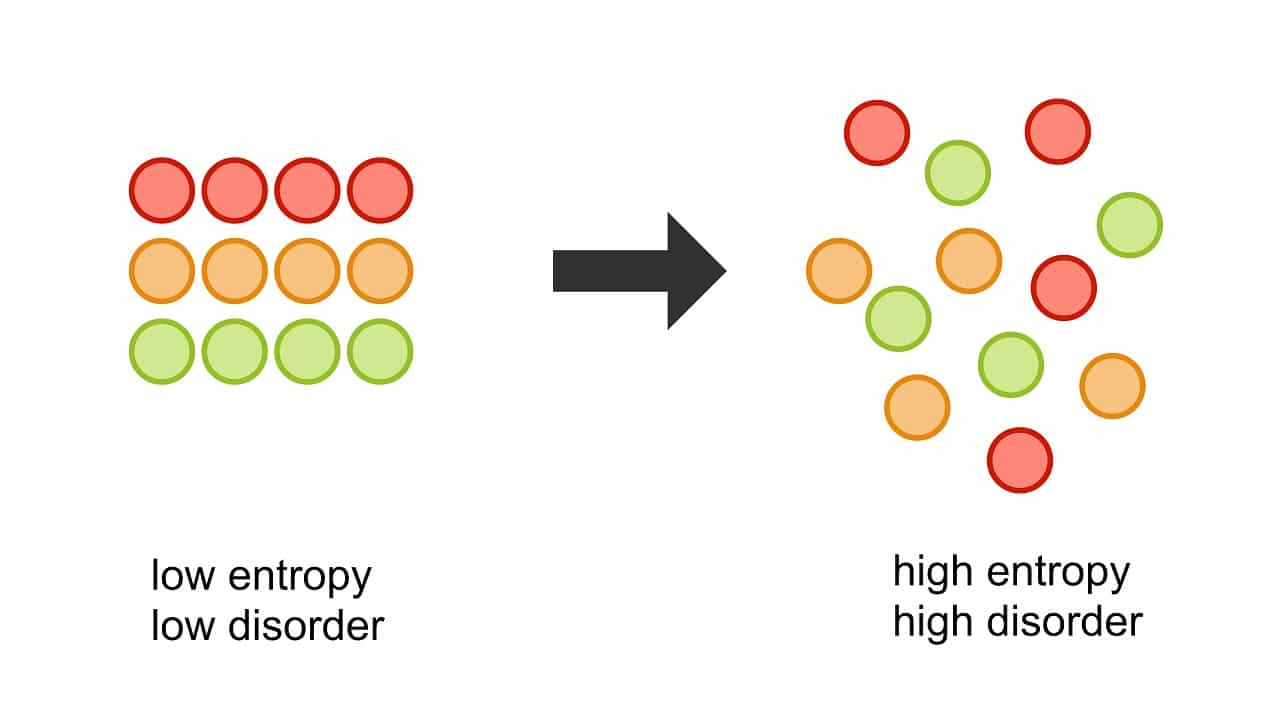

Entende-se também por entropia a medida da desordem de um sistema. A entropia, neste sentido, está associada a um grau de homogeneidade.

A entropia de formação de um composto químico é a diferença de entropia no processo formativo a partir dos elementos constituintes. Quanto maior a entropia de formação, mais favorável a sua formação.

Na teoria da informação, a entropia é a medida da incerteza que existe face a um conjunto de mensagens (das quais só se receberá uma única). Trata-se de uma medida da informação que é necessária para reduzir ou eliminar a incerteza.

Entende-se, por outro lado, por entropia como sendo a quantidade média de informação que contêm os símbolos transmitidos. Palavras como “o” ou “que” são os símbolos mais frequentes num texto mas que, no entanto, são os que fornecem menos informação. A mensagem tem informação relevante e máxima entropia desde que todos os símbolos sejam igualmente prováveis.

A linguística, por conseguinte, considera a entropia como o grau de informação discursiva ponderado em função da quantidade de lexemas.

Sobre a entropia e a desordem

Quando se fala em “desordem” na entropia, não se trata de uma bagunça, mas sim de um modo como um sistema foi organizado.

Outro modo de entender como isso funcionaria também seria pensar num recipiente com pedras vermelhas e outro com pedras amarelas e um terceiro recipiente vazio. Então se colocam as bolas vermelhas dentro daquele recipiente e depois as amarelas por cima, havendo uma organização por cores.

Mas quando esse pote é chacoalhado, as bolas ali se misturam. Então aquela organização inicial é afetada, não existindo mais. E, assim, mesmo chacoalhando o recipiente novamente não será possível fazer as bolas voltarem para a posição inicial. E assim, aquele sistema organizado, com ordem, tendo as bolas organizadas por cor (nesse caso, por duas cores), foi convertido num sistema agora desordenado, com as bolas de diferentes cores misturadas.

E a desordem de um sistema, quando aumentada, aumenta a entropia ali também.

Entropia e as leis da termodinâmica

O conceito de entropia teve seu desenvolvimento iniciado através de Nicolas Sadi Carnot. Carnot, que é pesquisador e também engenheiro, ao realizar pesquisas referentes ao processo que ocorre quando a energia mecânica é convertida em energia térmica e quando ocorre o contrário também, concluiu ser impossível haver uma máquina térmica totalmente eficiente.

A Primeira Lei da Termodinâmica é a que determina o princípio da conservação da energia, relatando que a energia não se perde quando há os processos físicos, senão que a mesma é convertida em outro tipo de energia.

Um exemplo nesse caso é quando ocorre a degradação da energia mecânica em energia térmica. Pode haver uma máquina que use energia para a realização de um processo e nisso a mesma aqueça. Mas cabe dizer que, nesse caso, a energia térmica não seria convertida outra vez em energia mecânica, sendo esse processo algo que não se pode reverter.

Tempos depois, o físico-matemático e engenheiro britânico chamado de Lord Kelvin complementou as pesquisas feitas por Carnot que tratavam da irreversibilidade dos processos termodinâmicos, o que resultou na criação dos fundamentos para a Segunda Lei da Termodinâmica.

Mas a primeira pessoa a fazer uso do termo entropia foi o físico e matemático alemão Rudolf Clausius, no ano de 1865.

Assim, a entropia nesse conceito seria o processo que permite fazer a medição do quanto há de energia térmica qual não se pode converter em energia mecânica numa dada temperatura.

Equipe editorial de Conceito.de. (5 de Março de 2014). Atualizado em 16 de Dezembro de 2022. Entropia - O que é, conceito e definição. Conceito.de. https://conceito.de/entropia